Подржано учење

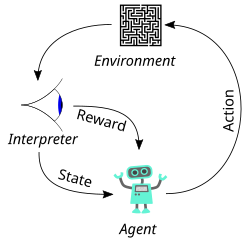

Подржано учење (енгл. reinforcement learning – RL) подручје је машинског учења и оптималне контроле које се бави тиме како би интелигентни агенти требали одабрати акције у окружењу како би максимизовали појам кумулативне награде. Подржано учење једно је од три основне парадигме машинског учења, уз надзирано учење и ненадзирано учење.

Подржано учење се разликује од надзираног учења по томе што не захтева приказивање означених улазно/излазних парова, као ни обавезно исправљање субоптималних акција. Уместо тога, фокус је на проналажењу равнотеже између истраживања (непознатих подручја) и искориштавања (тренутног знања).[1] Окружење се обично изражава у облику Марковљевог процеса одлучивања (МДП) јер многи алгоритми подржаног учења у овом контексту користе технике динамичког програмирања.[2]

Главна разлика између класичних метода динамичког програмирања и алгоритама подржаног учења је да подржано учење не претпоставља познавање тачног математичког модела МДП-а и да циља на велике МДП-ове за које тачне методе постају немогуће.[3]

Формализација проблема

уредиЗалеђина

уредиПодржано учење се углавном дефинише као Марковљев процес одлучивања назван по руском математичару Маркову. Модел је конципиран као скуп стања која поседују све информације о систему односно околини које моделују. Свако од стања омогућује што прецизније предвиђање последица сваке изведене радње. МДП се формално записује као четверац , при чему је:

- : множина свих могућих стања.

- : множина свих могућих радњи у сваком стању.

- : вероватноћа прелаза у стање , под претпоставком да се налазимо у стању и да је извршена радња .

- : награда / казна

Стратегија

уредиЦиљ поступка је пронаћи стратегију понашања (полицy) π: , која за свако стање [4]:61 и акцију максимизира очекивану будућу награду. Стратегија се може мењати током учења зависно од количине добијених награда.

Постоји неколико опција за одабир акције, на пример:

- похлепна: увек ће бити изабрана најбоља акција -

- ε-похлепна: углавном ће бити изабрана најбоља акција, повремено са вероватноћом ε биће одабрана и насумична акција

Вредност функције

уредиПостоје две сличне варијанте вредности функције

- Функције вредности стања (стате валуе фунцтион)

- Функције вредности прелаза између стања (стате-ацтион валуе фунцтион)

Функције вредности дефиниране су као алат за тражење максималне суме свих очекиваних награда помоћу следећег алгоритма:

- Чекај награду у будућности с фактором умањења γ:

- Уважавајући стања :

- Уважавајући прелазе између стања :

Види још

уредиРеференце

уреди- ^ Каелблинг, Леслие П.; Литтман, Мицхаел L.; Мооре, Андреw W. (1996). „Реинфорцемент Леарнинг: А Сурвеy”. Јоурнал оф Артифициал Интеллигенце Ресеарцх. 4: 237—285. С2ЦИД 1708582. арXив:цс/9605103 . дои:10.1613/јаир.301. Архивирано из оригинала 20. 11. 2001. г.

- ^ ван Оттерло, M.; Wиеринг, M. (2012). Реинфорцемент леарнинг анд марков децисион процессес. Реинфорцемент Леарнинг. Адаптатион, Леарнинг, анд Оптимизатион. 12. стр. 3—42. ИСБН 978-3-642-27644-6. дои:10.1007/978-3-642-27645-3_1.

- ^ Ли, Схенгбо (2023). Реинфорцемент Леарнинг фор Сеqуентиал Децисион анд Оптимал Цонтрол (Фирст изд.). Спрингер Верлаг, Сингапоре. стр. 1—460. ИСБН 978-9-811-97783-1. С2ЦИД 257928563. дои:10.1007/978-981-19-7784-8.

- ^ „Реинфорцемент леарнинг: Ан интродуцтион” (ПДФ). Архивирано из оригинала (ПДФ) 12. 7. 2017. г. Приступљено 2. 4. 2023.

Литература

уреди- Ауер, Петер; Јаксцх, Тхомас; Ортнер, Роналд (2010). „Неар-оптимал регрет боундс фор реинфорцемент леарнинг”. Јоурнал оф Мацхине Леарнинг Ресеарцх. 11: 1563—1600.

- Бусониу, Луциан; Бабуска, Роберт; Де Сцхуттер, Барт; Ернст, Дамиен (2010). Реинфорцемент Леарнинг анд Дyнамиц Программинг усинг Фунцтион Аппроxиматорс. Таyлор & Францис ЦРЦ Пресс. ИСБН 978-1-4398-2108-4.

- Франçоис-Лавет, Винцент; Хендерсон, Петер; Ислам, Риасхат; Беллемаре, Марц Г.; Пинеау, Јоелле (2018). „Ан Интродуцтион то Дееп Реинфорцемент Леарнинг”. Фоундатионс анд Трендс ин Мацхине Леарнинг. 11 (3–4): 219—354. Бибцоде:2018арXив181112560Ф. С2ЦИД 54434537. арXив:1811.12560 . дои:10.1561/2200000071.

- Поwелл, Wаррен (2011). Аппроxимате дyнамиц программинг: солвинг тхе цурсес оф дименсионалитy. Wилеy-Интерсциенце. Архивирано из оригинала 31. 7. 2016. г. Приступљено 2. 4. 2023.

- Суттон, Рицхард С. (1988). „Леарнинг то предицт бy тхе метход оф темпорал дифференцес”. Мацхине Леарнинг. 3: 9—44. дои:10.1007/БФ00115009 . Архивирано из оригинала 30. 3. 2017. г. Приступљено 2. 4. 2023.

- Сзита, Истван; Сзепесвари, Цсаба (2010). „Модел-басед Реинфорцемент Леарнинг wитх Неарлy Тигхт Еxплоратион Цомплеxитy Боундс” (ПДФ). ИЦМЛ 2010. Омнипресс. стр. 1031—1038. Архивирано из оригинала (ПДФ) 14. 7. 2010. г.

- Суттон, Рицхард С.; Барто, Андреw Г. (2018). Реинфорцемент Леарнинг: Ан Интродуцтион (2нд изд.). МИТ Пресс. ИСБН 978-0-262-03924-6.

- Ли, Схенгбо Ебен (2023). Реинфорцемент Леарнинг фор Сеqуентиал Децисион анд Оптимал Цонтрол (1ст изд.). Спрингер Верлаг, Сингапоре. ИСБН 978-9-811-97783-1. дои:10.1007/978-981-19-7784-8.

- Бертсекас, Димитри П. (2023). РЕИНФОРЦЕМЕНТ ЛЕАРНИНГ АНД ОПТИМАЛ ЦОНТРОЛ (1ст изд.). Атхена Сциентифиц. ИСБН 978-1-886-52939-7.

- Аннасwамy, Анурадха M. (3. 5. 2023). „Адаптиве Цонтрол анд Интерсецтионс wитх Реинфорцемент Леарнинг”. Аннуал Ревиеw оф Цонтрол, Роботицс, анд Аутономоус Сyстемс (на језику: енглески). 6 (1): 65—93. ИССН 2573-5144. С2ЦИД 255702873. дои:10.1146/аннурев-цонтрол-062922-090153 .

Спољашње везе

уреди- Реинфорцемент Леарнинг Репоситорy

- Реинфорцемент Леарнинг анд Артифициал Интеллигенце (РЛАИ, Рицх Суттон'с лаб ат тхе Университy оф Алберта)

- Аутономоус Леарнинг Лабораторy (АЛЛ, Андреw Барто'с лаб ат тхе Университy оф Массацхусеттс Амхерст)

- Реал-wорлд реинфорцемент леарнинг еxпериментс Архивирано 2018-10-08 на сајту Wayback Machine ат Делфт Университy оф Тецхнологy

- Станфорд Университy Андреw Нг Лецтуре он Реинфорцемент Леарнинг

- Диссецтинг Реинфорцемент Леарнинг Сериес оф блог пост он реинфорцемент леарнинг wитх Пyтхон цоде

- А (Лонг) Пеек инто Реинфорцемент Леарнинг